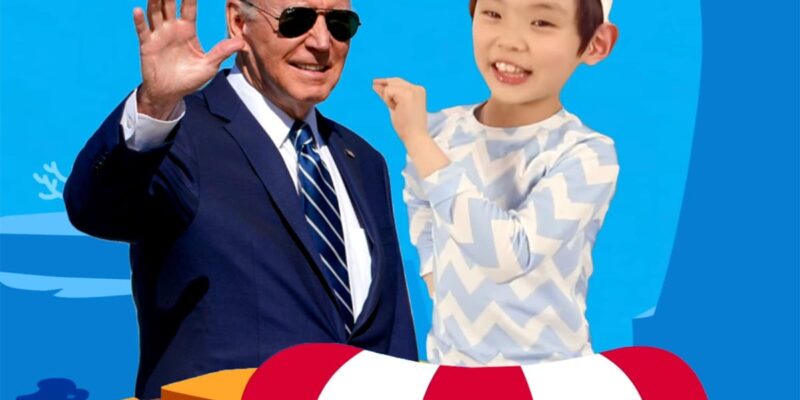

No, Joe Biden no cantó el “Baby Shark” canción.

Pero un vídeo viral de deepfake en el que se ve al presidente estadounidense lanzando la melodía infantil convenció a mucha gente de que sí lo había hecho.

Del mismo modo, un clip de un niño gritando “cállate la boca” a la primera dama Jill Biden durante una recepción para celebrar el Diwali nunca sucedió.

El clip fue compartido en Twitter por una cuenta pro-Maga donde había recibido más de 600.000 visitas para el jueves.

Una sucesión de vídeos deepfakes dirigidos a figuras políticas se han hecho virales en el período previo a las elecciones intermedias de noviembre, avivando la preocupación de que puedan desempeñar un papel en la determinación del resultado de las carreras ajustadas.

Los deepfakes se realizan mediante programas de inteligencia artificial que se manipulan a partir de vídeos auténticos para tergiversar las acciones y palabras de una persona.

La creación de contenidos hiperrealistas, que antes era un proceso caro y complejo, es ahora barata y está fácilmente disponible para los desarrolladores en sitios como GitHub.

En un momento en que la confianza en los medios de comunicación es cerca de un mínimo histórico, según Gallup Research, y la Gran Mentira de que Donald Trump ganó en 2020 ha creado una profunda desconfianza en las elecciones, los deepfakes son la última arma en una guerra de información en curso.

Pero creen que el verdadero peligro radica en la capacidad del clip para circular rápidamente en línea, y que las empresas de medios sociales no están haciendo nada para frenar la amenaza.

A medida que los vídeos deepfakes se vuelven “extremadamente frecuentes”, las plataformas sociales se encogen de hombros ante el problema, dijo el Dr. Abd-Almageed.

El Dr. Abd-Almageed ha desarrollado, junto con sus estudiantes de la USC, herramientas que permitirían a las empresas de redes sociales señalar los deepfakes, o incluso impedir que se publiquen contenidos falsos.

Dijo que ofreció las herramientas a las empresas de medios sociales de forma gratuita, y les imploró que las utilizaran para detener la propagación de la desinformación, y le dijeron explícitamente: “No nos importa”.

“Hay muchas cosas que pueden hacer, pero no les interesa hacer nada para detener la desinformación. Sólo quieren maximizar el compromiso de los usuarios, cuanta más gente se quede en la plataforma, más dinero ganan con la publicidad.”

El Dr. Abd-Almageed considera “chocante y aterrador” el escaso interés de las grandes plataformas de redes sociales por evitar la difusión de deepfakes.

“Ninguna herramienta será a prueba de balas, pero si pudiera detener el 50, 60 o 70 por ciento de estos deepfakes, es mucho mejor que nada. Lo que están haciendo ahora no es nada”, dijo.

Esto me quita literalmente el sueño”.

A informe publicado por el Servicio de Investigación del Congreso en junio advertía de que la proliferación de falsificaciones de fotos, audio y vídeo generadas por la inteligencia artificial podría plantear “problemas de seguridad nacional en los próximos años”.

“Adversarios del Estado o individuos con motivaciones políticas podrían publicar vídeos falsificados de funcionarios electos u otras figuras públicas haciendo comentarios incendiarios o comportándose de forma inapropiada”, descubrieron los investigadores.

“Hacerlo podría, a su vez, erosionar la confianza pública, afectar negativamente al discurso público o incluso influir en unas elecciones”.

El Dr. Abd-Almageed está de acuerdo en que un vídeo falso podría utilizarse fácilmente para manipular el resultado de unas elecciones.

Por ejemplo, un vídeo falso en el que se afirma que el presidente está extremadamente enfermo y moribundo se publica en las redes sociales tres horas antes del cierre de las urnas el día de las elecciones.

El vídeo se hace viral, la gente empieza a creerlo y deja de ir a las urnas. En el tiempo que tardaría la Casa Blanca en desmentir la historia, los votantes podrían haber perdido la oportunidad de votar.

“Siempre hemos crecidoal pensar que ver es creer, incluso después de que alguien lo desmienta se hace muy difícil revertir esa creencia.”

Dijo que la solución puede ser que los legisladores obliguen a las plataformas sociales a frenar la avalancha de deepfakes.

“Todas estas plataformas se escudan diciendo que sólo somos un puesto de noticias, que no somos responsables del contenido de nuestras plataformas. Tienen que aceptar la responsabilidad moral y ética de luchar contra la desinformación”.

Separar lo real de lo falso

Días después de que Rusia invadiera Ucrania, un vídeo de Volodymyr Zelensky pidiendo a sus soldados que se rindieran se difundió rápidamente en Internet. Los piratas informáticos consiguieron difundirlo brevemente en la televisión ucraniana, antes de que pudiera ser desmentido por los funcionarios ucranianos.

El clip trucado del Sr. Biden cantando “Baby Shark” fue tomado de un discurso que dio en el Irvine Valley Community College, en California, el 14 de octubre.

En el clip, el presidente anuncia el himno nacional, pero en lugar de cantar “The Star-Spangled Banner” canta la letra inicial de la molesta y familiar “Baby Shark”.

El clip inicial publicado en TikTok recibió medio millón de visitas antes de ser retirado, y se extendió rápidamente en otras redes sociales.

Cientos de comentaristas creyeron que el clip era auténtico.

“Ha perdido la cabeza”, comentó una persona en TikTok.

“Señoras y señores, ¡esto es lo que está dirigiendo este país! ¿Cómo?”, escribió otro.

Los encargados de comprobar los hechos en el Associated Press desacreditaron el clip, pero sus esfuerzos por apagar las llamas de la desinformación invariablemente llegan a una audiencia mucho menor.

El creador del deepfake, Ali Al-Rikabi, un funcionario con sede en el Reino Unido, dijo al Associated Press que utilizó un software de clonación de voz para hacer que el Sr. Biden cantara la letra de “Baby Shark” y un software de sincronización de labios para hacer que sus labios coincidieran con las palabras.

En otra falsificación, las imágenes de Jill Biden aplaudiendo y cantando antes de un partido de los Eagles de Filadelfia de la NFL fueron alteradas digitalmente para cambiar el audio auténtico por un burdo cántico anti-Biden.

Reuters informó de que un solo tuit del clip falso recibió cientos de miles de visitas antes de ser retirado.

Un análisis realizado por la empresa de IA Deeptrace en 2020 descubrió que existían casi 15.000 falsificaciones profundas, más del doble que nueve meses antes. De ellos, el 96% eran pornográficos, y la gran mayoría superponían los rostros de celebridades a contenidos sexuales gráficos.

Las cifras exactas son difíciles de precisar, pero los expertos afirman que el número de falsificaciones profundas se ha disparado en los años posteriores.

Un subgrupo muy popular de falsificaciones profundas presenta mezclas de actores conocidos en papeles desconocidos, como Jim Carrey en El resplandor o Jerry Seinfeld en Pulp Fiction.

Tras la muerte del actor Paul Walker durante el rodaje de Fast and Furious 7, en 2013, Weta Digital utilizó la tecnología deepfake para mapear su rostro en los cuerpos de sus hermanos Cody y Caleb para completar la película con un enorme gasto.

La inteligencia artificial también se está utilizando para dar nueva vida a la interpretación de James Earl Jones de Darth Vader después de que el actor de 91 años diera su permiso para clonar su voz y grabar nuevas líneas para futuras películas de Disney.

Esa misma tecnología está disponible en sitios como GitHub para que cualquiera pueda utilizarla.

“El mundo de las redes sociales está muy sesgado, muy polarizado. La gente vive en sus cámaras de eco. Todo el mundo tiene un sesgo de confirmación, y nos gusta ver pruebas que apoyen nuestras creencias”, dijo el profesor Lyu.

“Si todo el mundo tiene una mayor conciencia de este tipo de manipulación mediática. Si saben que es falsa, eso evitará que tenga tanta repercusión”.

Comparte la preocupación por la difusión de deepfakes en una jornada electoral y cree que los peligros de inclinar la balanza en unas elecciones ajustadas son muy reales.

Dice que es necesario que los usuarios de las redes sociales comprueben la fuente y autentifiquen los clips antes de compartirlos con sus amigos.

Meta dice que no puede definir lo que constituye información errónea, ya que “el mundo cambia constantemente, y lo que es cierto un minuto puede no serlo al siguiente”.

Añade que elimina los mensajes que incitan a la violencia o que “pueden contribuir directamente a interferir en el funcionamiento de los procesos políticos”.

TikTok y Twitter no respondieron a una solicitud de comentarios.

En comentarios publicados en Twitter el jueves, Elon Musk dijo que no quería que la plataforma se convirtiera en un “paisaje infernal para todos”, después de que anteriormentediciendo que permitiría cualquier contenido que no infringiera las leyes locales.

Comments